フランスの人工知能スタートアップ企業であるMistral AIが、大規模言語モデル(LLM)ベースのモデレーションシステムとして、日本語を含めた多言語に対応したモデレーションAPIを発表しました。

このモデレーションAPIは、Mistral AIが開発するMinistral 8Bのファインチューニングバージョンを搭載しており、性的コンテンツやヘイトスピーチ、暴力的な内容、危険な活動、個人を特定できる情報など、9つの異なるカテゴリにわたって潜在的に有害なコンテンツを検出できるように設計されています。

Mistral AIのモデレーションAPIはテキスト用と会話コンテンツ用の2種類があり、英語・日本語・ドイツ語・フランス語・イタリア語・ポルトガル語・スペイン語・アラビア語・中国語・韓国語・ロシア語でトレーニングされているため、ネイティブで多言語に対応済み。 Mistral AIによるとこのモデレーションAPIは、Mistral AIが提供するチャットボットサービス「Le Chat」のモデレーションシステムに使われているものだとのこと。Mistral AIは「AIを有用なものにするためには、安全性が重要です。私たちは、下流のデプロイを保護するにはシステムレベルのガードレールが不可欠であると考えています」と述べています。

IT系ニュースサイトのVentureBeatは、「今回のMistral AIによるモデレーションAPIのリリースは、 Microsoft Azure、Qualcomm、SAPとの契約を含む、Mistral AIが最近行っている一連のパートナーシップに続くものです。Mistral AIはエンタープライズAI市場でますます重要なプレーヤーとしての地位を確立しており、2024年10月にはMistral Large 2を含むMistralのモデルを自社のインフラストラクチャでホストし、欧州の規制に準拠した安全なAIソリューションを顧客に提供すると発表しました」と述べています。 また、VentureBeatは「Mistral AIのアプローチが特に注目に値するのは、エッジコンピューティングと包括的な安全機能の両方に重点を置いている点です」と述べ、厳格なデータ保護規制を強いられている欧州企業にとって、データのプライバシーやコンプライアンスに対する懸念に対応したMistral AIのソリューションは魅力的だろうと評価しています。

日本 最新ニュース, 日本 見出し

Similar News:他のニュース ソースから収集した、これに似たニュース記事を読むこともできます。

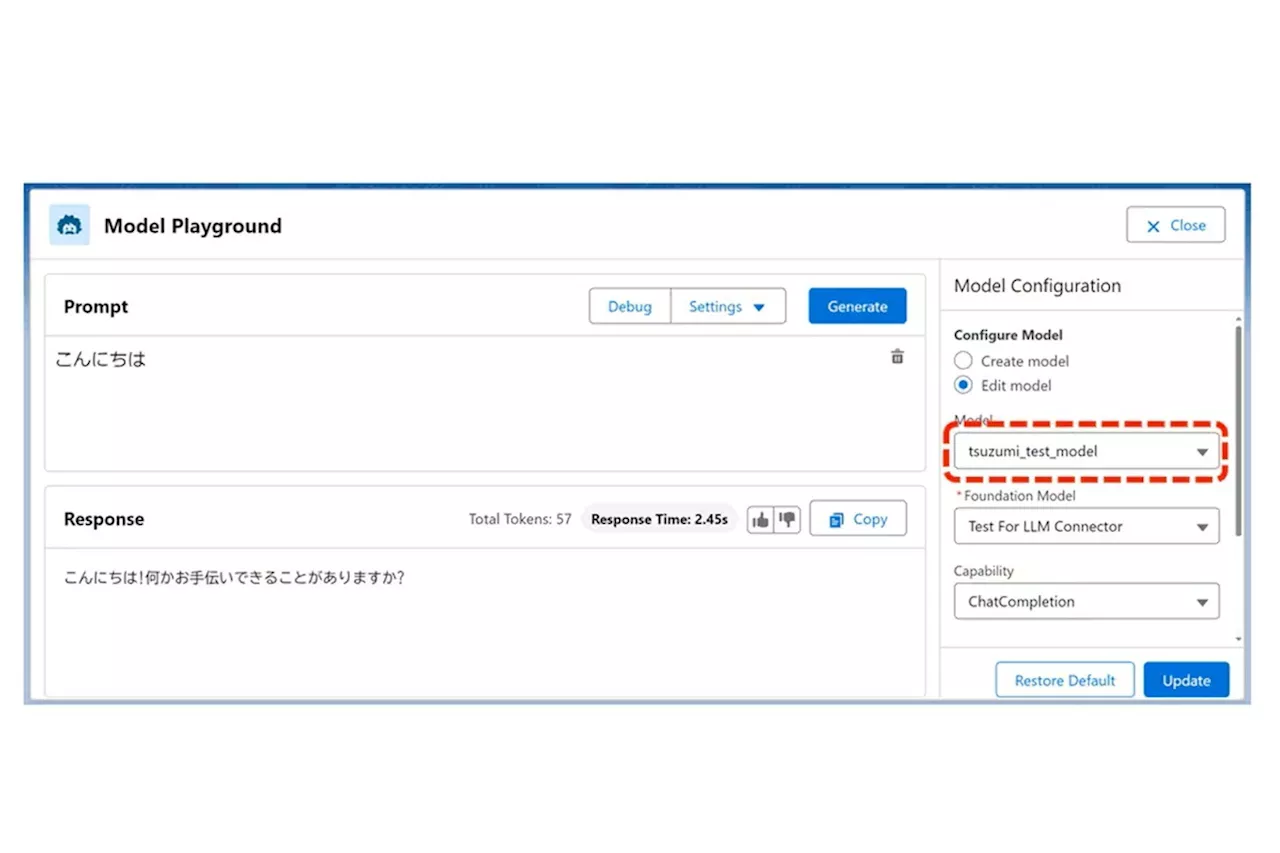

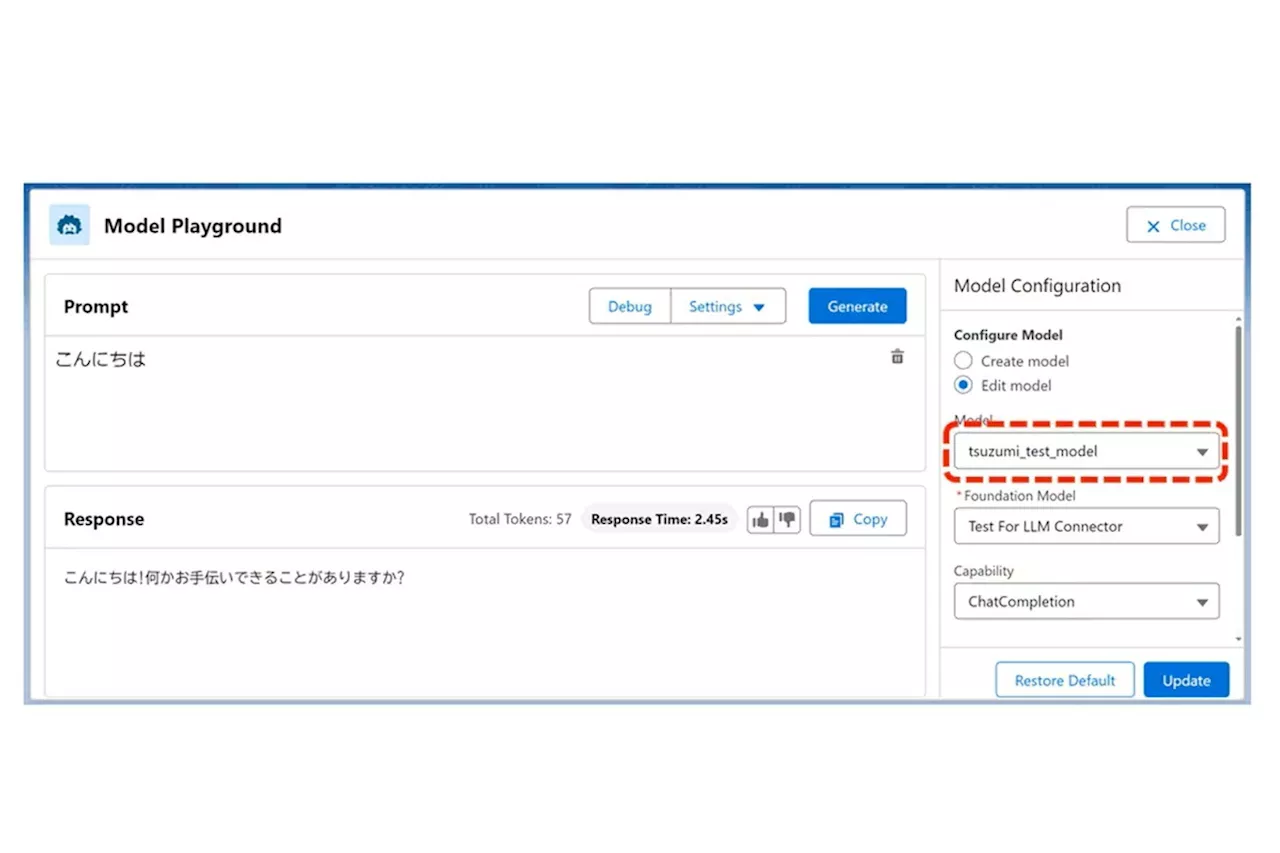

日本語に強いNTTやNECのLLMがSaleforceで利用可能にセールスフォース・ジャパンは、Salesforce Platformと大規模言語モデル(LLM)を統合する汎用コネクタ「Salesforce LLM Open Connector」を、2024年10月24日より国内提供することを発表した。

日本語に強いNTTやNECのLLMがSaleforceで利用可能にセールスフォース・ジャパンは、Salesforce Platformと大規模言語モデル(LLM)を統合する汎用コネクタ「Salesforce LLM Open Connector」を、2024年10月24日より国内提供することを発表した。

続きを読む »

日本語に強いNTTやNECのLLMがSaleforceで利用可能にセールスフォース・ジャパンは、Salesforce Platformと大規模言語モデル(LLM)を統合する汎用コネクタ「Salesforce LLM Open Connector」を、2024年10月24日より国内提供することを発表した。

日本語に強いNTTやNECのLLMがSaleforceで利用可能にセールスフォース・ジャパンは、Salesforce Platformと大規模言語モデル(LLM)を統合する汎用コネクタ「Salesforce LLM Open Connector」を、2024年10月24日より国内提供することを発表した。

続きを読む »

GPT-4やClaudeなどの大規模言語モデルが抱える「ストロベリー問題」とは?大規模言語モデル(LLM)をベースにしたAIは高い能力を発揮できる一方で、ウソにダマされやすいといった特徴があったり、算数の文章題への推論能力が小学生未満という研究結果があったりと、脆弱(ぜいじゃく)さについてもしばしば指摘されます。AIの能力の限界を示す「ストロベリー問題」という脆弱性について、機械学習エンジニアのチンメイ・ジョグ氏が解説しています。

GPT-4やClaudeなどの大規模言語モデルが抱える「ストロベリー問題」とは?大規模言語モデル(LLM)をベースにしたAIは高い能力を発揮できる一方で、ウソにダマされやすいといった特徴があったり、算数の文章題への推論能力が小学生未満という研究結果があったりと、脆弱(ぜいじゃく)さについてもしばしば指摘されます。AIの能力の限界を示す「ストロベリー問題」という脆弱性について、機械学習エンジニアのチンメイ・ジョグ氏が解説しています。

続きを読む »

主要生成AIモデル、欧州AI法違反の恐れ 評価テストで低スコアオープンAIのチャットGPTなど代表的な生成AI(人工知能)大規模言語モデル(LLM)が、欧州での評価テストで欧州連合(EU)が策定した世界初の包括的なAI規制「AI法」の重要な項目の基準を下回っていることが分かった。ロイターが閲覧したデータによると、サイバーセキュリティーに関する耐性や、差別や偏見を排した回答といったEUが重視する項目で低評価がついた。

主要生成AIモデル、欧州AI法違反の恐れ 評価テストで低スコアオープンAIのチャットGPTなど代表的な生成AI(人工知能)大規模言語モデル(LLM)が、欧州での評価テストで欧州連合(EU)が策定した世界初の包括的なAI規制「AI法」の重要な項目の基準を下回っていることが分かった。ロイターが閲覧したデータによると、サイバーセキュリティーに関する耐性や、差別や偏見を排した回答といったEUが重視する項目で低評価がついた。

続きを読む »

NVIDIAがMemoryXとSwarmXを発表し、大規模AIモデルのメモリ不足を解消NVIDIAは、大規模言語モデル(LLM)の成長に対応するために、新しいメモリアーキテクチャであるMemoryXとSwarmXを発表しました。このシステムでは、重みが中央のMemoryXに格納され、WSE-2と呼ばれるAIプロセッサーがアクティベーションのみを保持することで、メモリー不足の問題を解決します。

NVIDIAがMemoryXとSwarmXを発表し、大規模AIモデルのメモリ不足を解消NVIDIAは、大規模言語モデル(LLM)の成長に対応するために、新しいメモリアーキテクチャであるMemoryXとSwarmXを発表しました。このシステムでは、重みが中央のMemoryXに格納され、WSE-2と呼ばれるAIプロセッサーがアクティベーションのみを保持することで、メモリー不足の問題を解決します。

続きを読む »

NVIDIA MemoryX、大規模AIのメモリ不足を解決NVIDIAは、大規模言語モデル(LLM)向けの新しいメモリーアーキテクチャ「MemoryX」を発表しました。MemoryXは最大384GBを搭載し、従来のGPUやAIプロセッサーに比べて大幅なスケーラビリティを実現します。

NVIDIA MemoryX、大規模AIのメモリ不足を解決NVIDIAは、大規模言語モデル(LLM)向けの新しいメモリーアーキテクチャ「MemoryX」を発表しました。MemoryXは最大384GBを搭載し、従来のGPUやAIプロセッサーに比べて大幅なスケーラビリティを実現します。

続きを読む »