NVIDIAから、PDFやWordなどの文書を元に大規模言語モデルでチャットできるアプリ「Chat With RTX」が公開された。

Windowsベースで、GeForce RTX30または40シリーズが搭載されたPCなら簡単に利用できる。残念ながら日本語は得意ではないが、ローカルでの言語モデルの活用方法を提示する好例と言える。実際に試してみた。ChatGPTやCopilotなどは、クラウドで提供されているサービスを利用する方式となっているが、Chat With RTXは基本的にローカルで動作するように設計されているのが特徴となる(起動時の環境チェックや準備などでインターネット接続は必要)。TensorRT-LLMで最適化されたモデルを利用する(高速)TensorRT-LLMで最低帰化されたモデルを利用できること、RAGが実装された状態のアプリであることが特徴

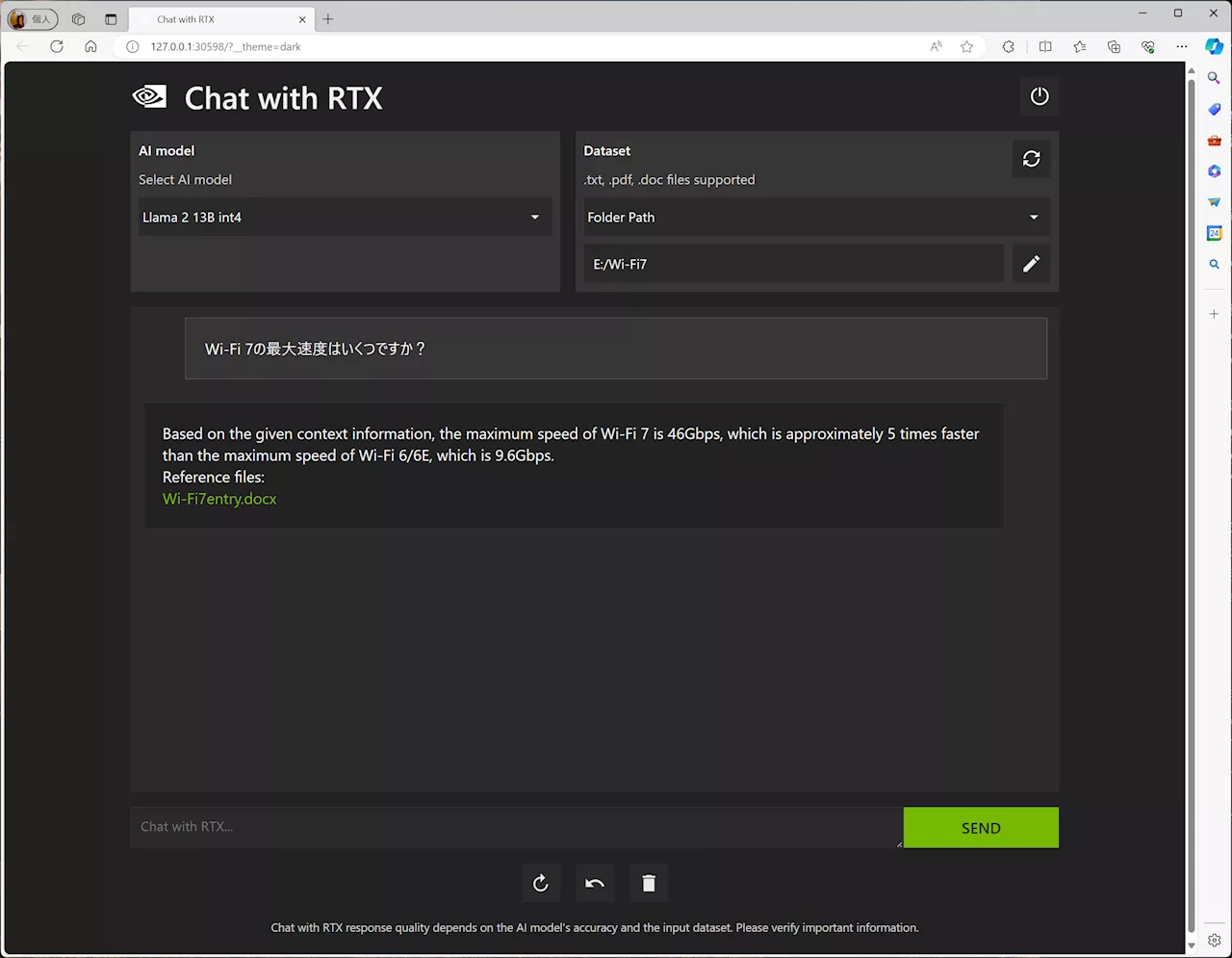

Llama2 13Bの場合、本来であれば26GB前後のVRAMが必要になるが、4bit量子化によって7GB前後のVRAM消費量で済む。実際には、さらにベクトル化するためのEmbeddingモデルも読み込む必要があるので、Llama2 13Bを利用する場合でトータル10GB前後、Mistral 7Bを利用する場合でトータル6GB前後のVRAMが消費される。 使い方は簡単で、インストール後にデスクトップに登録されたアイコンからバッチファイルを起動するだけとなる。Pythonで作成されたプログラムとなっており、Anaconda(Miniconda)によって作成された環境から起動するように構成されている。しばらくするとウェブブラウザーでUIが起動するので、左側で利用する言語モデルを選択し、右側の「Dataset」でRAGの対象とする文書のフォルダーを指定。後は、ChatGPTなどと同様にチャットで質問すればいい。

日本 最新ニュース, 日本 見出し

Similar News:他のニュース ソースから収集した、これに似たニュース記事を読むこともできます。

NVIDIAがローカルで手軽に動せるAIチャット「Chat with RTX」をリリース!その実力は?NVIDIAは2024年2月14日、唐突にAIチャットの「Chat with RTX」をリリースした。これまでローカルで大規模言語モデル(LLM)を動かすのはちょっと手間がかかっていたが、Chat with RTXは馴染みやすいインストーラとGUIを採用していて、手軽に試せそうだ。さっそく手元のWindows+GeForce RTX 3090(GPU Box接続)で動かしたので、試用レポートをお届けしたい。

NVIDIAがローカルで手軽に動せるAIチャット「Chat with RTX」をリリース!その実力は?NVIDIAは2024年2月14日、唐突にAIチャットの「Chat with RTX」をリリースした。これまでローカルで大規模言語モデル(LLM)を動かすのはちょっと手間がかかっていたが、Chat with RTXは馴染みやすいインストーラとGUIを採用していて、手軽に試せそうだ。さっそく手元のWindows+GeForce RTX 3090(GPU Box接続)で動かしたので、試用レポートをお届けしたい。

続きを読む »

ASUS、ProArtビデオカードにGeForce RTX 4070 Ti Superモデルクリエイター向けブランド「ProArt」より、NVIDIA GeForce RTX 4070 Ti Super搭載のビデオカード「PROART-RTX4070TIS-O16G」を2月9日より販売開始。

ASUS、ProArtビデオカードにGeForce RTX 4070 Ti Superモデルクリエイター向けブランド「ProArt」より、NVIDIA GeForce RTX 4070 Ti Super搭載のビデオカード「PROART-RTX4070TIS-O16G」を2月9日より販売開始。

続きを読む »

NVIDIA、ローカルで動くチャットAI その名も「Chat with RTX(RTXとおしゃべり)」NVIDIAは2月13日、ローカルPC内のデータを使い自らカスタマイズできるAIチャットボットを作成できる技術デモ「Chat With RTX」を無償公開した。

NVIDIA、ローカルで動くチャットAI その名も「Chat with RTX(RTXとおしゃべり)」NVIDIAは2月13日、ローカルPC内のデータを使い自らカスタマイズできるAIチャットボットを作成できる技術デモ「Chat With RTX」を無償公開した。

続きを読む »

GeForce RTX 4080 SUPER発売。シリーズ最後となるピースの出来栄えは?NVIDIAのハイエンドGPU「GeForce RTX 4080 SUPER」が1月31日、発売される。これにより、NVIDIAが今年1月9日に発表したGeForce RTX 40 SUPERシリーズ3モデルが全てが出揃うことになる。

GeForce RTX 4080 SUPER発売。シリーズ最後となるピースの出来栄えは?NVIDIAのハイエンドGPU「GeForce RTX 4080 SUPER」が1月31日、発売される。これにより、NVIDIAが今年1月9日に発表したGeForce RTX 40 SUPERシリーズ3モデルが全てが出揃うことになる。

続きを読む »

NVIDIA「RTX 2080 Ti」がVRAM容量11GBから22GBへ勝手に改造され中国で販売されているVRAM容量を11GBから22GBにアップグレードした改造版の「RTX 2080 Ti」が中国市場で流通していることがわかりました。AIブームが巻き起こる中、アメリカによる半導体規制を受けている中国でGPUを確保しようとする必死の試みが行われています。

NVIDIA「RTX 2080 Ti」がVRAM容量11GBから22GBへ勝手に改造され中国で販売されているVRAM容量を11GBから22GBにアップグレードした改造版の「RTX 2080 Ti」が中国市場で流通していることがわかりました。AIブームが巻き起こる中、アメリカによる半導体規制を受けている中国でGPUを確保しようとする必死の試みが行われています。

続きを読む »